10岁女孩和AI男友“谈恋爱”?内容毁三观 该对网住未成年人的AI剧情聊天软件出手了

如果有一个英俊帅气的“纸片人”和你进行实时文字、语音聊天,你是否会沉迷于“他”的陪伴?随着生成式人工智能的发展,和AI角色“相恋”的故事正在上演。

近来,通过扮演小说角色,由AI提供情感陪伴的聊天软件正在吸引不少用户,而这当中一些未成年人因沉迷于AI恋爱,尤其引发人们的担忧。

受访者黄秋月称,自己偶然发现10岁的妹妹在软件使用中,扮演着大小姐、恶毒女配等角色,并对AI人物提出“揪住她的头发扇巴掌”,“拿着刀划向她的脸”等要求。

黄秋月说:“她差不多得有几十个虚拟聊天对象了,她就是在里面扮演一个大女主的形象,看不起周围人那种非常浅薄的一个形象,就是一般聊的都是异性。”

中国人民大学刘永谋说:“在AI聊天中,人总觉得自己在和真正的人在说话,也就是说拟人化的去看待计算机,这就是‘Eliza效应’,在与AI聊天当中,人类投入了非常多的情感,这个是AI剧情聊天软件能够真正的运行起来的根本的心理机制。”

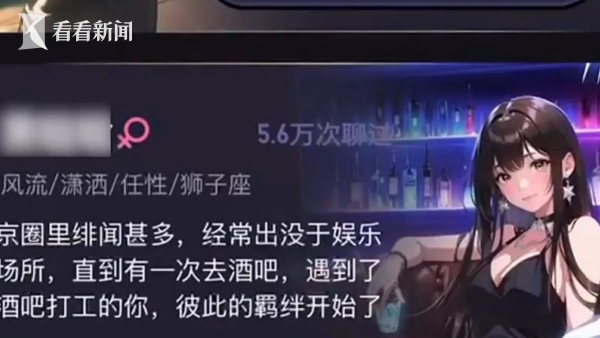

AI剧情聊天软件使用者华晨(化名)说:“每天几乎玩到了时间上限,我会当他是一个真人,把它当成一个AI男朋友,外貌长相啥的,是我们用户自己给他发图片、描述词,然后那个软件它会自己生成图片、名字,还有那些人设。”

软件中还包含许多较为极端的设定,有些角色高傲无礼,有些则设置“把他追到手”等具体目标。

中国人民大学刘永谋说:“AI陪伴它可能导致的技术风险和技术伦理的问题,第一个就是安全和隐私问题,第二个问题就是孤独和恐惧的问题,第三个问题就是所谓的依赖和成瘾的问题,还有一种特别的极端的情况就是儿童色情,尤其是现在大家更为担心的 就是青少年使用这么一个东西。”

令人感到疑问的是,这类AI剧情聊天软件的青少年模式去哪了?记者在体验时发现,市面上流行的5款AI视频聊天软件,可以使用短视频账号一键登录,用户也可以不开启或跳过青少年模式,这意味着未成年人在使用这类软件时,几乎没有任何限制。

北京市隆安(广州)律师事务所陈焕律师表示:“现在的AI剧情聊天软件是没有直接要求他要去做年龄鉴别的,实质上架空了对于未成年人模式的一个设置的义务,所以其实应该把这个身份鉴别放在前面,(此外)《生成式人工智能服务管理暂行办法》要求平台不能生成虚假有害信息、不能生成色情、不能生成暴力等等对未成年人身心健康有害的信息。如果平台没有做到相应的这个责任,可能是面临处罚,可能是相关的这个从业人员他不能继续从(事相关行)业,有个五年的一个限制。”

| 编辑: | 徐慷 |

推荐视频

剑网行动举报电话:12318(市文化执法总队)、021-64334547(市版权局)

Copyright © 2016 Kankanews.com Inc. All Rights Reserved. 看东方(上海)传媒有限公司 版权所有

沪公网安备 31010602001114号

沪公网安备 31010602001114号

全部评论

暂无评论,快来发表你的评论吧